Frankenstein es una novela gótica escrita por Mary Shelley en 1818 que cuenta la historia de un joven científico, Víctor Frankenstein, quien crea un ser a partir de la recombinación de partes de cuerpos humanos muertos. El resultado es una criatura que, aunque parece humana, es rechazada por la sociedad debido a su apariencia y comportamiento.

En Frankenstein, la creación del monstruo lleva a una serie de tragedias que abren una interrogante sobre la ética de la ciencia y la responsabilidad del creador, además de ser una feroz crítica a la Inglaterra victoriana de la época, llena de apariencias y rigores sociales, donde cada uno escondía su propio “monstruo” personal.

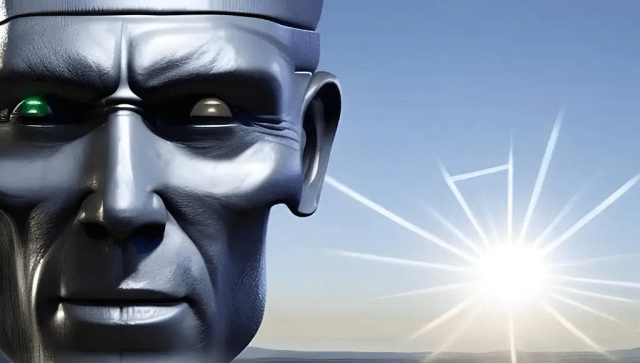

Hago esta introducción para presentar la interesante comparación entre la inteligencia artificial y el personaje de Frankenstein. En ambos se aborda la idea de la creación de una vida artificial, aunque desde perspectivas distintas.

Toda creación vinculada con la vida enfrenta dilemas éticos y morales sobre el papel de la humanidad en la generación de vida artificial y la responsabilidad que tenemos hacia las criaturas que creamos. A partir de la masificación de herramientas de IA, como el Chat GPT y otros, también se han planteado preocupaciones sobre los efectos negativos que la IA puede tener en la sociedad y en la vida humana, lo que ha llevado a debates sobre la ética y la responsabilidad en la creación y uso de la IA.

Por otro lado, la inteligencia artificial es un campo amplísimo de investigación científica y tecnológica que busca desarrollar sistemas que puedan realizar tareas que normalmente requieren inteligencia humana, como el aprendizaje, el razonamiento y la resolución de problemas. A diferencia del personaje de Frankenstein, la inteligencia artificial no es una entidad física, sino un conjunto de algoritmos y modelos matemáticos que se ejecutan en computadoras. Sin embargo, el eje de la discusión es la creación de una forma de vida a partir de múltiples partes, que combinadas, no se suman, sino que se potencian en una escala que puede ir bastante más allá de lo que sus promotores lo estimaron, obligándonos a reflexionar sobre las implicaciones éticas y morales de la creación de vida artificial y la responsabilidad que tenemos como creadores.

La inteligencia artificial se basa en la imitación de la inteligencia humana, al menos en su forma más común y conocida, que se relaciona con el aprendizaje automático. El objetivo de la IA es desarrollar sistemas que puedan realizar tareas que normalmente requieren inteligencia humana, como el reconocimiento de patrones, la comprensión del lenguaje natural, la toma de decisiones y la resolución de problemas. Los sistemas de aprendizaje automático utilizan redes neuronales artificiales que se asemejan a las redes neuronales del cerebro humano, lo que les permite aprender y mejorar su desempeño a medida que se les presenta más información. Los algoritmos de procesamiento del lenguaje natural también se centran en la comprensión del lenguaje humano y utilizan técnicas como el análisis semántico y la sintaxis para entender y generar texto.

Sin embargo, es importante destacar que la IA no imita completamente la inteligencia humana, ya que existen diferencias fundamentales entre una y otra. Por ejemplo, la inteligencia humana es capaz de realizar una amplia variedad de tareas y adaptarse a situaciones nuevas y desconocidas, mientras que la IA todavía se limita a tareas específicas y es menos adaptable a situaciones no previstas en su entrenamiento. Además, la inteligencia humana también está asociada con la conciencia, la creatividad y las emociones, aspectos que todavía no se han logrado reproducir completamente en la IA.

Pero volviendo a Frankenstein, el subtítulo de la novela de Shelley era El moderno Prometeo. Como sabemos, la historia sacada de la mitología griega sobre Prometeo ha sido vista como un símbolo de la creatividad y la innovación, pero también de la rebeldía y la resistencia frente a la autoridad, pues robó el fuego sagrado a los dioses y se lo entregó al hombre. La figura de Prometeo ha sido retratada en la literatura y el arte de muchas formas a lo largo de la historia, y ha inspirado diversas interpretaciones y lecturas.

En la actualidad, el nombre de Prometeo se asocia también con la tecnología y la innovación, especialmente en el campo de la inteligencia artificial. Por ejemplo, el nombre del proyecto de investigación en inteligencia artificial de Google, «Proyecto Prometeo», hace referencia a la idea de que la tecnología puede ser un catalizador de la creatividad y el progreso humano, aunque también implica responsabilidad y consecuencias potenciales.

Es cierto que la IA plantea importantes desafíos éticos y de seguridad, especialmente en términos de cómo se utilizan y controlan los sistemas de IA. En los círculos tecnológicos ha habido una discusión significativa sobre el diseño de sistemas de IA con niveles elevados de autonomía, estos podrían tomar decisiones que tengan consecuencias negativas para los seres humanos, especialmente si estos sistemas tienen acceso a infraestructura crítica como la energía, la salud, el transporte o la seguridad de los países.

Sin embargo, hoy se cree que la posibilidad de que la IA se convierta en un «monstruo» es baja, siempre y cuando se implementen medidas de seguridad y supervisión adecuadas. En este sentido han surgido varias iniciativas para establecer estándares y regulaciones para el uso de la IA, aunque es aun temprano para comenzar a entender las fronteras de este salto tecnológico, la preocupación es genuina y tiene cabida, sobre todo por la capacidad que han demostrado actores malignos en explotar estas ventajas a su favor.

Para tener una visión más amplia del riesgo de transformar la IA en un Frankestein recomiendo leer a Nick Bostrom, quien es filósofo y profesor de la Universidad de Oxford y ha escrito ampliamente sobre el futuro de la inteligencia artificial y los riesgos asociados con su desarrollo. Su obra más reconocida es el libro Superintelligence: Paths, Dangers, Strategies, en el que argumenta que la creación de una inteligencia artificial superinteligente podría ser peligrosa si no se implementan medidas adecuadas de control y regulación.

Según Bostrom, si los cerebros artificiales llegaran algún día a superar a los cerebros humanos en inteligencia general, entonces esta nueva forma de inteligencia llegaría a ser muy poderosa. Al igual que hoy el destino de los gorilas depende ahora más de los humanos que de ellos mismos, también el destino de nuestra especie pasaría a depender de las acciones de la superinteligencia artificial. Pero nosotros tenemos una ventaja: podemos hacer el primer movimiento.

No quiero contarles el final del libro de Bostrom, pero vale la pena leerlo.

*Para ser coherente con el tema, este artículo lo escribí con ayuda de Chat GPT y la imagen que lo ilustra fue generada con la herramienta de IA de Canva